Zahlen lügen nicht?

In der Goethe-Universität Frankfurt findet gerade eine hochkarätig besetzte Online-Ringvorlesung zum Themenbereich des Umgangs mit Algorithmen statt. Unter der Überschrift Zahlen lügen nicht? Algorithmen zwischen Kontrolle und Vertrauen erklären namhafte Vortragende die zunehmenden Dimensionen und den Einfluss von Algorithmen auf unser tägliches Leben.

Den Vortrag Zahlen lügen nicht? – Von trügerischer Objektivität und historic bias bei algorithmenbasiertem Kreditscoring – Katja Langenbucher (Professorin für Bürgerliches Recht, Wirtschaftsrecht und Bankrecht, Goethe-Universität) hat ein Studierender für uns mit seinen Worten zusammengefasst.

Liebes UniWehrsEl,

Deutsche Banken sind nach dem Kreditwesengesetz in Deutschland verpflichtet, vor der Vergabe eines Kredits an einen Kreditnehmer eine sogenannte Bonitätsprüfung durchzuführen. Eine Bonitätsprüfung bedeutet, dass sich der Kreditnehmer durch eine Prüfung seiner Zahlungsfähigkeit für einen Kredit bei einer Bank qualifiziert.

Dies geschieht über eine Basis von qualifizierten ausgewählten Daten über den Kreditnehmer. In den 1950er Jahren nahm der Banker eine persönliche Einschätzung des Kunden vor, auf Grundlage von persönlichen Merkmalen, z.B. gehen wir gemeinsam zur selben Kirche oder in denselben Golfclub und bewegen uns in denselben Kreisen? Diese persönliche Einschätzung des Bankers versuchte die Bank später mittels Schufa-Auskunft zu optimieren.

Dabei interessierte die Bank mittels Schufa-Auskunft zu ermitteln, ob der Kunde seine vorherigen Kredite gut bezahlt hat. Auf Basis dieser Vergangenheitseinschätzung versuchte er die Wahrscheinlichkeit zu berechnen, wie hoch das Risiko ist, dass der Schuldner seinen Kredit nicht weiter zurückzahlen kann.

Die Schufa vergibt also so etwas wie ‚Schuldnoten‘ für Kreditnehmer. Dieses System hat sich für die Bank bewährt. Ist aber für den Kunden nicht sehr transparent, weil die Schufa ihr System der Datensammlung nicht vollständig offenlegt. Nach einem Urteil des Bundesgerichtshofes muss die Schufa ihr Scoring (Bewertungssystem) gegenüber dem Verbraucher nicht vollständig offenlegen, weil dieses System unter das Betriebsgeheimnis der Schufa fällt.

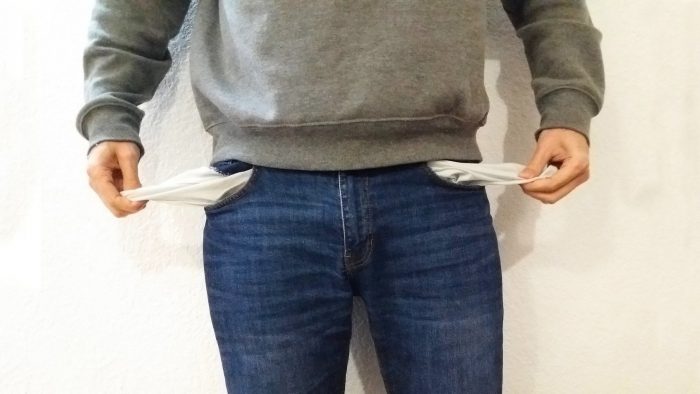

Für den potentiellen Kreditnehmer entsteht so das Risiko, dass er nicht herausfinden kann woran es liegt, dass er keinen Kredit erhält, und er so sein Zahlungsverhalten auch nicht ändern kann. Die Bank sucht neben der Schufa-Auskunft nach weiteren Möglichkeiten ihr Risiko des Kreditausfalls bei einem Kreditnehmer zu minimieren.

Nun gibt es Datenanbieter, die mittels algorithmischen Scorings der Bank versprechen, das Ausfallrisiko weiter zu senken. Diese Datenanbieter argumentieren, dass beim algorithmischen Scoring noch andere Daten in die individuelle Bewertung des potentiellen Kreditnehmers einfließen, die noch genauer ermitteln lassen, ob der Kreditnehmer in Zukunft seinen Zahlungsverpflichtungen nachkommen wird als mittels des Schufa-System, das nur die Zahlungsmoral in der Vergangenheit bewertet und eine Prognose für die Zukunft abgibt.

Beim algorithmischen Scoring wird das Zahlungsverhalten nicht nur aus der Vergangenheit angesehen, sondern mit anderen Gesichtspunkten mittels weiterer Daten neu gewichtet und bewertet. Diese neuen Daten, die in die Bewertung einfließen können, seien z.B. das Einkaufsverhalten bei Amazon, der Musikgeschmack des Kunden, der Wohnort des Kunden. Diese Daten sollen die Kreditausfallwahrscheinlichkeit genauer festlegen. Dies nennt sich ‚lineare Regressionsanalyse‘.

Wie objektiv ist diese Datensammlung? Die Kreditvergabe auf einer breiteren Datenbasis hat den Vorteil einer verbesserten Vorhersagewahrscheinlichkeit. Jedoch basiert diese Vergabe auf dem derzeitig erhobenen Datenmaterial, das trotzdem fehlerhaft sein kann.

Außerdem hat die Bank eigene Interessen, z.B. ist sie ihren Aktionären verpflichtet, Ausfallrisiken zu vermeiden, den Ruf der Bank zu wahren und das Vertrauen in den Kapitalmarkt nicht durch leichtsinnige Kreditvergaben an schlechte Kreditnehmer zu gefährden. Das Geschäftsmodell der Bank soll Sicherheit vermitteln und für Stabilität am Kapitalmarkt sorgen.

Die erhobene Datensammlung der Bank enthält Verhaltensweisen des Kunden mit stark korrelierenden Variablen, z.B. hört gerne Rapmusik und wohnt in einer schlechten Gegend, macht unregelmäßig Sport oder Erhebung durch eine ‚Fitnessapp‘. Dies führt zur Schlussfolgerung aus Datenlage: Kunde zahlt nicht regelmäßig seinen Kredit zurück.

Dabei werden bei der Datenerhebung auch sogenannte historical bias (historische Kennziffern) erhoben. Diese historischen Kennziffern können zur Benachteiligung von Gruppen und fehlerhaften Datensätzen führen.

Ein Beispiel: früher waren Frauen nicht berufstätig, sondern Hausfrauen. Hausfrauen können einen Kredit schlechter zurückzahlen, es sei denn, sie waren reiche Erbinnen. Deshalb sind Frauen schlechte Kreditnehmer und bekommen einen Kredit nur zu schlechteren Bedingungen.

In den USA als Beispiel für historical bias: schwarze Bürger haben in der Vergangenheit schlechter bezahlte Jobs annehmen müssen und erzielten dadurch ein geringeres Einkommen. Deshalb erhalten sie einen Kredit zu einer schlechteren Bedingung als weiße Bürger. Dies führt zu Rassismus von Gruppen bei der Datenerhebung. Rassistische Tendenzen in Datensätzen können nicht einfach herausgerechnet werden, weil die Datenbasis insgesamt nicht stimmt und zu einer weiteren Verzerrung führt.

Das ist für beide Seiten ein Problem, der schlecht bewertete Kunde erhält keinen Kredit, aber auch für die Bank kann die historische Kennziffer gefährlich sein, weil der Bank potentielle Kunden entgehen, wenn sie aus falschen Vergangenheitsannahmen – z.B. Frauen gehen nie arbeiten – als Bewertungsmaßstab zu Grunde gelegt werden.

Wie viele Variablen bringen nun einen Mehrwert für das Kreditausfallrisiko? Bei den Naturwissenschaften bringen immer neue Variablen gute Ergebnisse, aber bei der Finanzwissenschaft kommt durch noch mehr Variable keine neuen Erkenntnisse hinzu. Daher hat die empirische Datenerhebung Grenzen.

In der Praxis: zwei genau identische Menschen gibt es nicht. Daher kann auch die Einschätzung des Kreditnehmers fehlerhaft sein. Es ist daher fraglich, ob diese algorithmische Datenanalyse immer akkurate Ergebnisse liefert. Daraus folgt, wie gut ist die Qualitätskontrolle der Datensätze durch die Bank? Gibt es eine menschliche Überwachung der algorithmischen Datensätze bzw. werden diese vom Sachbearbeiter hinterfragt?